הדעה הרווחת והנשנית על פריצות הדרך האחרונות במחקר בינה מלאכותית היא שמכונות חיוניות ואינטליגנטיות ממש עומדות באופק. מכונות מבינות פקודות מילוליות, מבדילות תמונות, נוהגות במכוניות ומשחקות משחק טוב יותר מאיתנו. כמה זמן יכול להיות עוד לפני שהם הולכים בינינו?

הדו"ח החדש של הבית הלבן על בינה מלאכותית רואה השקפה ספקנית כראוי לגבי אותו חלום. נאמר כי 20 השנים הבאות לא יראו כי מכונות "מציגות אינטליגנציה הניתנת להחלה רחבה בהשוואה לזו של בני אדם או מעבר לה," אם כי היא ממשיכה לומר שבשנים הקרובות, "מכונות יגיעו ויעלו את הביצועים האנושיים יותר ועוד משימות. " אולם הנחותיה לגבי אופן ההתפתחות של יכולות אלה פספסו כמה נקודות חשובות.

כחוקר AI, אודה שהיה נחמד שהתחום שלי מודגש ברמה הגבוהה ביותר של הממשל האמריקני, אך הדו"ח התרכז כמעט אך ורק במה שאני מכנה "סוג המשעמם של AI." זה ביטל בחצי משפט את ענף המחקר שלי ב- AI, כיצד האבולוציה יכולה לסייע בפיתוח מערכות AI שהשתפרו תמיד, וכיצד מודלים חישוביים יכולים לעזור לנו להבין כיצד התפתחה האינטליגנציה האנושית שלנו.

הדו"ח מתמקד במה שניתן לכנות כלי AI המיינסטרים: למידת מכונה ולמידה עמוקה. אלה סוגים של טכנולוגיות שהצליחו לשחק "Jeopardy!" ובכן, והכו אדוני Go אנושיים במשחק הכי מסובך שהומצא אי פעם. מערכות אינטליגנטיות עכשוויות אלו מסוגלות להתמודד עם כמויות אדירות של נתונים ולעשות חישובים מורכבים במהירות רבה. אך חסר להם אלמנט שיהיה המפתח לבניית המכונות הרוחות שאנו מדמיינים בעתיד.

עלינו לעשות יותר מללמד מכונות ללמוד. עלינו להתגבר על הגבולות המגדירים את ארבעת הסוגים השונים של בינה מלאכותית, את המחסומים המפרידים מכונות מאיתנו - ואנחנו מהם.

AI סוג I: מכונות תגוביות

הסוגים הבסיסיים ביותר של מערכות AI הם תגובתיים גרידא, ואין להם יכולת לא ליצור זיכרונות ולא להשתמש בחוויות עבר כדי ליידע החלטות עכשוויות. כחול עמוק, מחשב העל משחק השחמט של יבמ, שניצח את הסבתא הבינלאומית גארי קספרוב בסוף שנות התשעים, הוא הדוגמא המושלמת לסוג זה של מכונה.

כחול עמוק יכול לזהות את השברים על לוח שחמט ולדעת כיצד כל אחד זז. זה יכול לעשות תחזיות לגבי המהלכים שעשויים להיות הבאים עבורו ויריבו. וזה יכול לבחור את המהלכים האופטימליים ביותר מבין האפשרויות.

אבל אין לזה שום מושג של פעם, וגם לא שום זיכרון של מה שקרה בעבר. פרט לכלל הספציפי לשחמט המשמש לעיתים רחוקות נגד חזרה על אותו מהלך שלוש פעמים, כחול עמוק מתעלם מהכל לפני הרגע הנוכחי. כל מה שהוא עושה זה להסתכל על החלקים שעל לוח השחמט כפי שהם עומדים ברגע זה, ולבחור מבין המהלכים הבאים האפשריים.

אינטליגנציה מסוג זה כוללת את המחשב שתופס את העולם באופן ישיר ופועל על מה שהוא רואה. זה לא מסתמך על מושג פנימי של העולם. במאמר זרע טען חוקר AI רודני ברוקס שעלינו לבנות רק מכונות כאלה. הסיבה העיקרית שלו הייתה שאנשים לא כל כך טובים בתכנות עולמות מדומים מדויקים לשימוש במחשבים, מה שמכונה במלגת AI "ייצוג" של העולם.

המכונות האינטליגנטיות הנוכחיות שאנו מתפעלים מהן אינן בעלות תפיסת עולם כזו, או שיש להן מוגבלת ומיוחדת מאוד לתפקידים הספציפיים שלה. החידוש בעיצוב כחול עמוק לא היה להרחיב את מגוון הסרטים האפשריים שהמחשב שקל. במקום זאת, המפתחים מצאו דרך לצמצם את השקפתה, להפסיק לרדוף אחר כמה מהלכים עתידיים פוטנציאליים, על סמך האופן בו הוא דירג את התוצאה שלהם. ללא יכולת זו, כחול עמוק היה צריך להיות מחשב חזק עוד יותר כדי לנצח את קספרוב בפועל.

באופן דומה, גם AlphaGo של גוגל, שגברה על מומחי Go האנושיים המובילים, לא יכולה להעריך את כל המהלכים העתידיים הפוטנציאליים. שיטת הניתוח שלה מתוחכמת יותר משיטת Deep Blue, באמצעות רשת עצבית כדי להעריך את התפתחויות המשחק.

שיטות אלה אכן משפרות את יכולתן של מערכות AI לשחק טוב יותר במשחקים ספציפיים, אך לא ניתן לשנות אותן בקלות או ליישם אותן במצבים אחרים. לדמיונות הממוחשבים האלה אין מושג של העולם הרחב - כלומר הם לא יכולים לתפקד מעבר למשימות הספציפיות שהוטלו עליהם והם שוללים בקלות.

הם אינם יכולים להשתתף באופן אינטראקטיבי בעולם, כפי שאנו מדמיינים מערכות AI יום אחד. במקום זאת, מכונות אלה יתנהגו בדיוק באותה צורה בכל פעם שהם נתקלים באותו מצב. זה יכול להיות טוב מאוד להבטיח שמערכת AI אמינה: אתה רוצה שהמכונית האוטונומית שלך תהיה נהג אמין. אבל זה רע אם אנו רוצים שמכונות יתקשרו באמת עם העולם ויגיבו אליו. מערכות ה- AI הפשוטות הללו לעולם לא ישעממו, לא יתעניינו, או עצובות.

סוג II AI: זיכרון מוגבל

סוג זה II מכיל מכונות יכולות להסתכל על העבר. מכוניות בנהיגה עצמית כבר עושות חלק מזה. לדוגמה, הם מתבוננים במהירות ובכיוון של מכוניות אחרות. זה לא יכול להיעשות ברגע אחד בלבד, אלא דורש זיהוי עצמים ספציפיים ומעקב אחריהם לאורך זמן.

תצפיות אלה מתווספות לייצוגים המתוכנתים מראש של המכוניות הנוהגות בעצמן, הכוללות גם סימוני נתיב, רמזורים ושאר גורמים חשובים, כמו עקומות בכביש. הם כלולים כשהמכונית מחליטה מתי להחליף נתיבים, להימנע מניתוק נהג אחר או שנפגע על ידי מכונית סמוכה.

אך פיסות המידע הפשוטות הללו על העבר הן רק חולפות. הם לא נשמרים כחלק מספריית הניסיון של המכונית שהיא יכולה ללמוד ממנה, הדרך בה נהגים אנושיים אוספים ניסיון לאורך שנים מאחורי ההגה.

אז איך ניתן לבנות מערכות AI הבונות ייצוגים מלאים, לזכור את החוויות שלהם וללמוד כיצד להתמודד עם מצבים חדשים? ברוקס צדק בכך שקשה מאוד לעשות זאת. המחקר שלי על שיטות בהשראת האבולוציה הדרוויניסטית יכול להתחיל לפצות על חסרונות אנושיים בכך שאפשר למכונות לבנות ייצוגים משלהם.

סוג III AI: תורת הנפש

אנו עשויים לעצור כאן, ולקרוא לנקודה זו את ההפרדה החשובה בין המכונות שיש לנו לבין המכונות שנבנה בעתיד. עם זאת, עדיף להיות ספציפיים יותר לדון בסוגי הייצוגים שמכונות צריכים להיווצר, ועל מה עליהם להיות קשורים.

מכונות בכיתה הבאה, המתקדמת יותר, לא רק מייצגות ייצוגים על העולם, אלא גם לגבי סוכנים או ישויות אחרות בעולם. בפסיכולוגיה זה נקרא "תורת הנפש" - ההבנה שאנשים, יצורים וחפצים בעולם יכולים להיות בעלי מחשבות ורגשות המשפיעים על התנהגותם שלהם.

זה חיוני לאופן בו אנו בני האדם הקמנו חברות, מכיוון שהם אפשרו לנו לקיים אינטראקציות חברתיות. מבלי להבין זה את המניעים והכוונות של זה, ובלי לקחת בחשבון את מה שמישהו אחר יודע עלי או על הסביבה, העבודה המשותפת היא במקרה הטוב קשה, במקרה הרע בלתי אפשרית.

אם מערכות AI אכן יצעדו בקרבנו אי פעם, הן יצטרכו להבין שלכל אחד מאיתנו יש מחשבות ורגשות וציפיות כיצד יתייחסו אלינו. והם יצטרכו להתאים את התנהגותם בהתאם.

סוג IV IV: מודעות עצמית

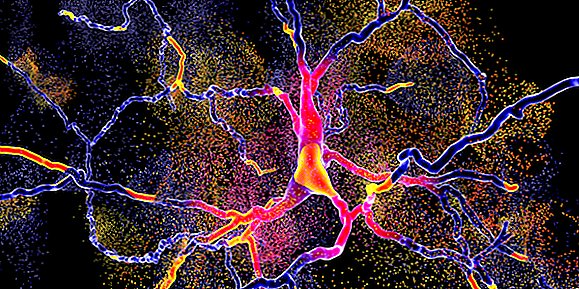

השלב האחרון בפיתוח AI הוא בניית מערכות שיכולות ליצור ייצוגים לגבי עצמם. בסופו של דבר, אנו חוקרי ה- AI נצטרך להבין לא רק את התודעה, אלא לבנות מכונות שיש להן.

זה, במובן מסוים, הרחבה של "תיאוריית הנפש" שיש בידי אינטליגנציות מלאכותיות מסוג III. התודעה נקראת גם "מודעות עצמית" מסיבה. ("אני רוצה את הפריט הזה" היא אמירה שונה מאוד מ"אני יודע שאני רוצה את הפריט הזה. ") יצורים מודעים מודעים לעצמם, יודעים על מצבים הפנימיים ומסוגלים לחזות רגשות של אחרים. אנו מניחים שמישהו שמצפר מאחורינו בתנועה כועס או חסר סבלנות, כי ככה אנו מרגישים כשאנחנו צופרים באחרים. ללא תיאוריית תודעה, לא היינו יכולים לבצע סוגים אלה של מסקנות.

בעוד שאנחנו כנראה רחוקים מלהקים מכונות שמודעות לעצמן, עלינו למקד את מאמצינו להבנת הזיכרון, הלמידה והיכולת לבסס החלטות על חוויות מהעבר. זהו צעד חשוב להבנת האינטליגנציה האנושית בפני עצמה. וזה קריטי אם ברצוננו לתכנן או לפתח מכונות שהם יותר יוצאי דופן בסיווג של מה שהם רואים מולם.

ארנד הינצה, פרופסור עוזר לביולוגיה אינטגרטיבית ומדעי המחשב והנדסה, אוניברסיטת מישיגן